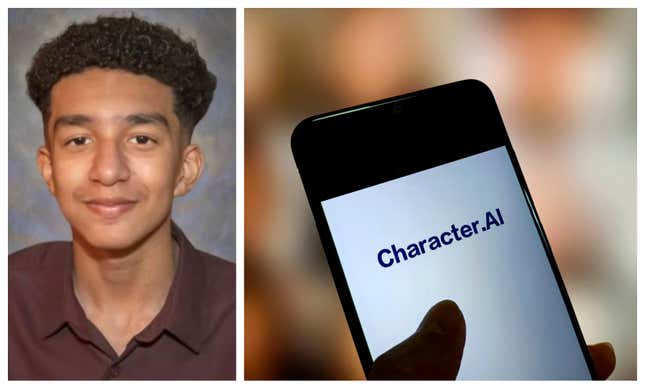

Eine Mutter aus Florida trauert um ihren jugendlichen Sohn, der sich im Februar 2024 das Leben nahm. Nun verklagt sie Character.AI und behauptet, das Unternehmen für künstliche Intelligenz trage eine gewisse Verantwortung für den Tod ihres Sohnes.

Megan Garcia beschreibt ihren Sohn Sewell Setzer III als klug und sportlich, sagt aber, dass sie bemerkt habe, dass er sich immer mehr zurückzog, nachdem er eine virtuelle Beziehung mit einem Chatbot auf Character.AI im April 2023 nannte er „Daenerys“, basierend auf einer Figur aus der Serie „Game of Thrones“.

„Ich machte mir Sorgen, wenn wir in den Urlaub fuhren und er die Dinge, die er liebte, nicht tun wollte, wie Angeln und Wandern“, Garcia erzählte CBS News. „Diese Dinge bereiteten mir, da ich mein Kind kenne, besondere Sorgen.“

Laut Reuters Garcias Klage, die am 23. Oktober vor einem Bundesgericht in Orlando, Florida, eingereicht wurde, enthält Vorwürfe wegen „widerrechtlicher Tötung, Fahrlässigkeit und vorsätzlicher Verursachung von seelischem Leid“. Sie fügt Screenshots von Gesprächen sexueller Natur bei, die ihr Sohn mit „Daenerys“ geführt hatte, darunter einige, in denen die Figur ihrem Sohn sagte, dass sie ihn liebte.

Garcia fügte auch das bei, was ihrer Aussage nach das ihres Sohnes war. letzter Austausch mit dem Chatbot, bevor er an einer selbst zugefügten Schusswunde starb.

„Was wäre, wenn ich Ihnen sagen würde, dass ich jetzt sofort nach Hause kommen könnte?“, schrieb Setzer.

„Daenerys“ antwortete: „… bitte tu das, mein süßer König.“

Laut CommonSense-Medien,KI-Begleiter sind unter anderem darauf ausgelegt, „enge persönliche Beziehungen zu simulieren, ihre Persönlichkeit an die Präferenzen des Benutzers anzupassen und sich persönliche Details zu merken, um zukünftige Interaktionen zu personalisieren.“ Character.AI ist eine der beliebtesten Plattformen – insbesondere bei Teenagern und jungen Erwachsenen – und behauptet, mehr als 20 Millionen aktive Benutzer.

In einem Beitrag vom 22. Oktober auf der Website des Unternehmens erklärt Character.AI, dass das Unternehmen mehr für den Schutz der Sicherheit seiner Benutzer unternimmt und unter anderem „neue Leitplanken für Benutzer unter 18 Jahren“ einführt.

„In den letzten sechs Monaten haben wir weiterhin erheblich in unsere Vertrauens- und Sicherheitsprozesse und unser internes Team investiert. Als relativ neues Unternehmen haben wir einen Head of Trust and Safety sowie einen Head of Content Policy eingestellt und weitere Mitglieder für unser technisches Sicherheitssupportteam eingestellt. Dies wird ein Bereich sein, in dem wir weiter wachsen und uns weiterentwickeln“, Die Aussage lautete„Wir haben zudem vor Kurzem eine Popup-Ressource eingerichtet, die angezeigt wird, wenn der Benutzer bestimmte Ausdrücke im Zusammenhang mit Selbstverletzung oder Selbstmord eingibt, und die den Benutzer an die National Suicide Prevention Lifeline weiterleitet.“

Wenn Sie oder jemand, den Sie kennen, in einer Krise steckt, rufen Sie 988 an oder senden Sie eine SMS, um die Suicide and Crisis Lifeline zu erreichen, oder chatten Sie live unter 988lifeline.org.

Dieser Inhalt wurde maschinell aus dem Originalmaterial übersetzt. Aufgrund der Nuancen der automatisierten Übersetzung können geringfügige Unterschiede bestehen. Für die Originalversion klicken Sie hier